1. Abstract

Topic Modeling은 간단하게 말하자면, 문서의 집합에서 topic을 찾아내는 프로세스를 말합니다.

이는 검색엔진, 고객 민원 시스템 등과 같이 문서의 주제를 알아내는 일이 중요한 곳에서 사용합니다.

나도 client들이 반응을 검색을 할 때, benzene, water은 시약이라는 주제를 알고, room temperature 는 조건, bial은 시약통 같은 topic들을 추려내서 내가 원하는 결과를 알도록 도와줄 수 있다.

2. LDA의 가정

LDA는 문서의 집합으로부터 어떤 토픽이 존재하는지를 알아내기 위한 알고리즘입니다.

LDA는 앞서 배운 빈도수 기반의 표현 방법인 BoW의 행렬 DTM 또는 TF-IDF 행렬을 입력으로 하는데, 이로부터 알 수 있는 사실은 LDA는 단어의 순서는 신경쓰지 않겠다는 겁니다.

'나는 이 문서를 작성하기 위해서 이런 주제들을 넣을거고, 이런 주제들을 위해서는 이런 단어들을 넣을 거야.'

1) 문서에 사용할 단어의 개수 N을 정합니다.

- Ex) 5개의 단어를 정하였습니다.

2) 문서에 사용할 토픽의 혼합을 확률 분포에 기반하여 결정합니다.

- Ex) 위 예제와 같이 토픽이 2개라고 하였을 때 강아지 토픽을 60%, 과일 토픽을 40%와 같이 선택할 수 있습니다.

3) 문서에 사용할 각 단어를 (아래와 같이) 정합니다.

3-1) 토픽 분포에서 토픽 T를 확률적으로 고릅니다.

- Ex) 60% 확률로 강아지 토픽을 선택하고, 40% 확률로 과일 토픽을 선택할 수 있습니다.

3-2) 선택한 토픽 T에서 단어의 출현 확률 분포에 기반해 문서에 사용할 단어를 고릅니다.

- Ex) 강아지 토픽을 선택하였다면, 33% 확률로 강아지란 단어를 선택할 수 있습니다.

이제 3)을 반복하면서 문서를 완성합니다.

이러한 과정을 통해 문서가 작성되었다는 가정 하에 LDA는 토픽을 뽑아내기 위하여 위 과정을 역으로 추적하는 역공학(reverse engneering)을 수행합니다.

3. LDA의 수행하기

1) 사용자 -> 알고리즘, 토픽의 개수 k 제공

앞서 말하였듯이 LDA에게 토픽의 개수를 알려주는 역할은 사용자의 역할입니다. LDA는 토픽의 개수 k를 입력받으면, k개의 토픽이 M개의 전체 문서에 걸쳐 분포되어 있다고 가정합니다.

2) 모든 단어를 k개 중 하나의 토픽에 할당합니다.

이제 LDA는 모든 문서의 모든 단어에 대해서 k개 중 하나의 토픽을 랜덤으로 할당합니다.

이 작업이 끝나면 각 문서는 토픽을 가지며, 토픽은 단어 분포를 가지는 상태입니다.

물론 랜덤으로 할당하였기 때문에 사실 이 결과는 전부 틀린 상태입니다.

만약 한 단어가 한 문서에서 2회 이상 등장하였다면, 각 단어는 서로 다른 토픽에 할당되었을 수도 있습니다.

3) 이제 모든 문서의 모든 단어에 대해서 아래의 사항을 반복 진행합니다. (iterative)

3-1) 어떤 문서의 각 단어 w는 자신은 잘못된 토픽에 할당되어져 있지만,

다른 단어들은 전부 올바른 토픽에 할당되어져 있는 상태라고 가정합니다.

이에 따라 단어 w는 아래의 두 가지 기준에 따라서 토픽이 재할당됩니다.

- p(topic t | document d) : 문서 d의 단어들 중 | 토픽 t에 해당하는 단어들의 비율

- p(word w | topic t) : 토픽 t 중 | 단어 w를 갖고 있는 모든 문서들 비율

이를 반복하면, 모든 할당이 완료된 수렴 상태가 됩니다.

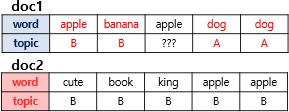

위의 그림은 두 개의 문서 doc1과 doc2를 보여줍니다. 여기서는 doc1의 세번째 단어 apple의 토픽을 결정하고자 합니다.

우선 첫번째로 사용하는 기준은 문서 doc1의 단어들이 어떤 토픽에 해당하는지를 봅니다. doc1의 모든 단어들은 토픽 A와 토픽 B에 50 대 50의 비율로 할당되어져 있으므로, 이 기준에 따르면 단어 apple은 토픽 A 또는 토픽 B 둘 중 어디에도 속할 가능성이 있습니다.

두번째 기준은 단어 apple이 전체 문서에서 어떤 토픽에 할당되어져 있는지를 봅니다. 이 기준에 따르면 단어 apple은 토픽 B에 할당될 가능성이 높습니다.

이러한 두 가지 기준을 참고하여 LDA는 doc1의 apple을 어떤 토픽에 할당할지 결정합니다.

4. 잠재 디리클레 할당과 잠재 의미 분석의 차이

LSA : DTM을 차원 축소 하여 축소 차원에서 근접 단어들을 토픽으로 묶는다.

LDA : 단어가 특정 토픽에 존재할 확률과 문서에 특정 토픽이 존재할 확률을 결합확률로 추정하여 토픽을 추출한다.

'AI' 카테고리의 다른 글

| 자연어처리 : Word Embedding : Glove (Global Vectors for Word Representation, GloVe) (0) | 2020.03.15 |

|---|---|

| 자연어처리 : Word Embedding : Word2Vec, CBOW, Skip-Gram, Negative Sampling (0) | 2020.03.14 |

| 자연어 처리 : Topic Modeling : 잠재의미분석 (LSA) (2) | 2020.03.12 |

| 자연어처리 : Word Embedding (0) | 2020.03.12 |

| DL : Keras Sequential method 정리 (0) | 2020.03.11 |

댓글